Forrásrendszer

Termékkatalógus, rendelések és clickstream események JSON fixture-ökben. Ezekből indul az SQL, Python és Docker alapozás.

Építs végig egy modern adat- és AI-platformot lokálisan: Delta Lake, Spark, feature store, RAG chatbot, MLflow, Docker, Kubernetes és monitoring — egy közös webshop esettanulmányon keresztül.

Akik szeretnének elsajátítani modern data toolokat: Delta Lake, Spark, Airflow, dbt, Databricks.

Akik mélyebben meg akarják érteni a data pipeline-okat, adatminőséget és lakehouse architektúrát.

Akik pályát akarnak módosítani data engineering vagy AI engineering irányba, gyakorlati projektekkel.

Akik RAG rendszert, ML deployment-et, monitoringot vagy feature store-t akarnak építeni.

Válaszd ki a számodra megfelelő útvonalat, és haladj a kurzusok sorrendjében. A zöld pipa jelöli az általad teljesített kurzusokat.

15 interaktív, projektalapú és magyar nyelvű kurzus. Minden kurzus kész és azonnal elkezdhető — kattints az info ikonra a részletes előnézetért.

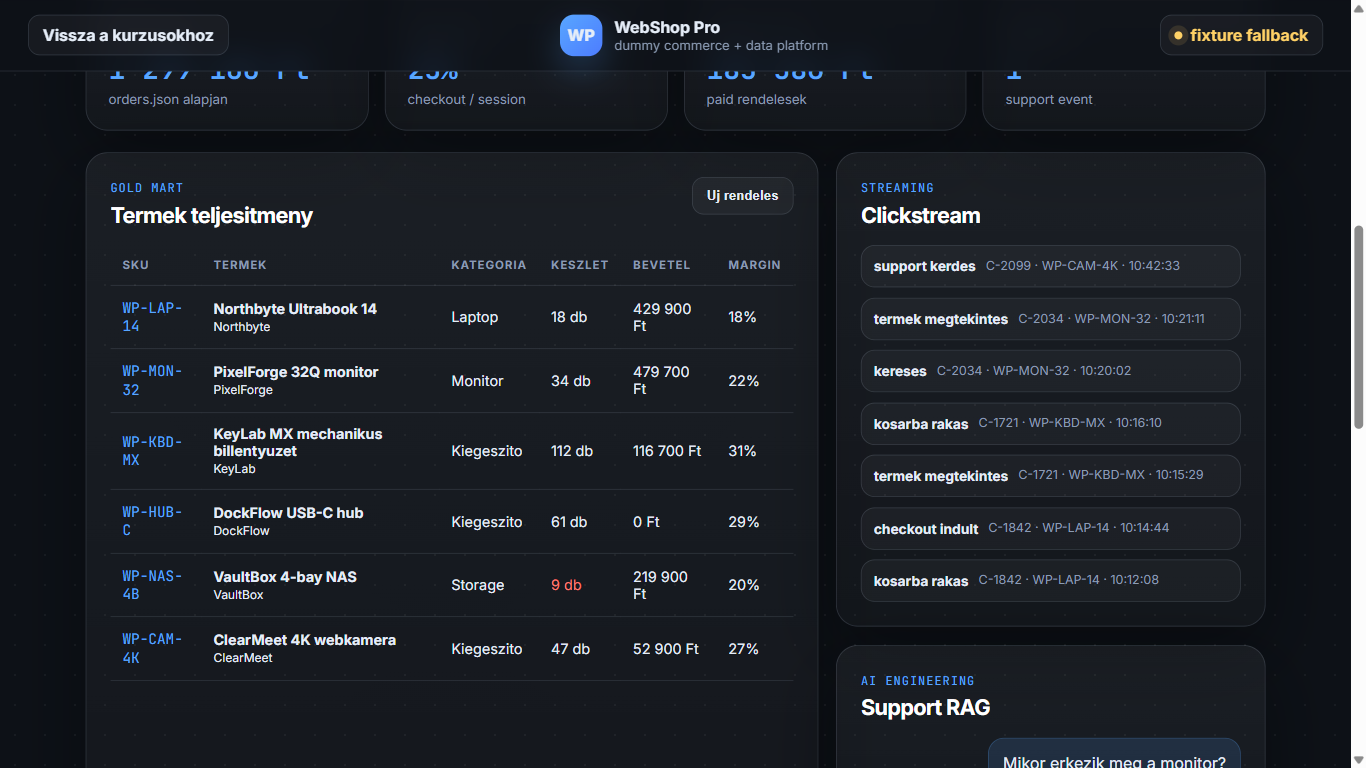

A kurzusok egy közös dummy webshopra épülnek. Ugyanazokkal a rendelésekkel, termékekkel és clickstream eseményekkel dolgozol SQL-ben, Pythonban, Sparkban, Delta Lake-ben, dbt-ben, RAG-ben és MLOps-ban is.

A Local Docker Lab elindítja a webshopot, az adatbázist, az adatpipeline-eszközöket, az AI/RAG réteget és a monitoringot. A Local Docker Lab oldalon minden service-nél látod, melyik kurzushoz tartozik, milyen URL-en éred el, és kell-e hozzá belépési adat.

docker compose up -d --build

Termékkatalógus, rendelések és clickstream események JSON fixture-ökben. Ezekből indul az SQL, Python és Docker alapozás.

Bronze/Silver/Gold rétegek Delta Lake-kel és Sparkkal. Itt tanulod meg a tisztítást, joinokat, time travelt és optimalizálást.

dbt martok készülnek napi bevételhez, termékteljesítményhez és customer lifetime value riportokhoz.

RAG ügyfélszolgálat, churn modell, MLflow tracking, FastAPI serving és Grafana monitoring ugyanarra a webshopra.

A kurzusok nem önéletrajz-díszítők — gyakorlati tudást adnak, amit valódi állásinterjún és projekten használhatsz. Az alábbi szerepekre direkt módon készítenek fel.

Pipeline-okat épít, adatokat mozgat és transzformál. Ez az oldal Foundation + Data Engineering útvonalát járja be.

Híd az adatmérnök és a data analyst között. dbt-vel és SQL-lel rétegzett analitikai modelleket épít.

LLM és ML modelleket integrál production rendszerekbe. RAG, eval, MLOps a mindennapok.

ML infrastruktúra, deployment, monitoring és drift. CI/CD pipeline ML modellekre.

Databricks, Azure/AWS/GCP lakehouse platformokat üzemeltet és fejleszt.

Real-time adatfeldolgozás Kafka és Flink/Spark stack-kel. Event-driven architektúrák.

* Magyar piaci bérsáv, 2025 végi adatok alapján (Profession.hu, Pallon, Hays). A konkrét bér cég, senioritás és régió függő.

Valós production környezetben használt eszközök — nem Hello World demók, hanem tényleges szakmai toolkit.

A kurzusok egy szilárd alapot adnak, de a data/AI engineering rohamosan fejlődő terület. Ezek a források segítenek naprakészen maradni.

A data & AI engineering legfontosabb referenciaművei.

A legjobb ingyenes tartalom a téma iránt érdeklődőknek.

Minőségi ingyenes programok, ha mélyebbre akarsz ásni.

Fórumok, hol szakmai kérdésekre választ kaphatsz.

Heti-havi frissítések a területről.

Gyors referencia a napi munkához.

Junior és medior data engineereknek, analytics engineereknek, backend fejlesztőknek, akik data vagy AI engineering irányba mennek, és AI engineereknek, akik RAG rendszert vagy MLOps-ot akarnak építeni. Ha teljesen kezdő vagy, a Foundation útvonal (SQL + Python + Docker) megadja az alapokat.

Teljesen ingyenes, nyílt forráskódú (MIT License). Regisztráció sem szükséges — bármelyik kurzust azonnal elkezdheted.

Kurzustól függően 2–6 óra. Saját tempóban haladhatsz — a haladás automatikusan mentődik a böngésződben. Az összes kurzus kb. 60–80 óra intenzív munkát igényel, ha lineárisan végigcsinálod.

A Foundation útvonal (SQL, Python, Docker) nulláról indul. A haladóbb kurzusokhoz a kurzuskártyáknál feltüntetjük az előfeltételeket — ezek közt általában Delta Lake és Spark alapismeret szerepel.

Egy átlagos laptop bőven elég (8 GB RAM ajánlott, 16 GB kényelmesebb). A lokális példák szándékosan kis adathalmazon futnak, hogy mindenki ki tudja próbálni őket. A Docker-alapú kurzusokhoz érdemes legalább 20 GB szabad lemez.

Jelenleg nem adunk hivatalos tanúsítványt. A cél a gyakorlati tudás: a GitHub repo és az elkészült projektek beszélnek magukért az állásinterjúkon. Ha bővíted a saját portfóliódat a kurzus-projektekkel (és továbbfejleszted őket), az önmagában erősebb, mint egy certifikát.

Nézd meg a Tanulási útvonalak szekciót. Három előre megtervezett útvonal van: Foundation (kezdőknek alap), Data Engineering (teljes DE pipeline), AI Engineering (LLM és MLOps). Minden útvonal logikus sorrendben építi fel a tudást.

A projekt nyílt forráskódú a GitHub-on. Pull request, issue, typo-javítás, új kurzus-ötlet mind jöhet. Ha egy kurzust elvégeztél és hasznosnak találtad, a legjobb köszönet ha megosztod LinkedIn-en vagy valakinek, aki tanul.

Mindegyik kurzus lépésről lépésre van magyarázva, és minden kódrészlet lokálisan futtatható. Ha elakadsz: (1) ellenőrizd a pontos parancsot/verzió-t, (2) nézd meg a kurzus bootstrap scriptjét (bootstrap.sh / bootstrap.ps1), (3) nyiss egy GitHub Issue-t.

A kurzusok a 2026-os helyzetet tükrözik a főbb eszközökkel: Delta Lake 3.x, Spark 3.5+, Databricks Unity Catalog, OpenAI-modellek, MLflow 2.x. Ha szakmai változás van, GitHubon követheted: csillagozd a repót, és kapcsold be a Watch figyelést.